Toepassingen als ChatGPT nemen op dit moment een hoge vlucht. Google komt binnenkort bijvoorbeeld met ‘Bard’ dat een beter en meer betrouwbaar alternatief moet worden voor ChatGPT. Hoe risicovol zijn dergelijke toepassingen? Deze vraag kun je m.i. niet los zien van de context waarin deze applicaties worden gebruikt.

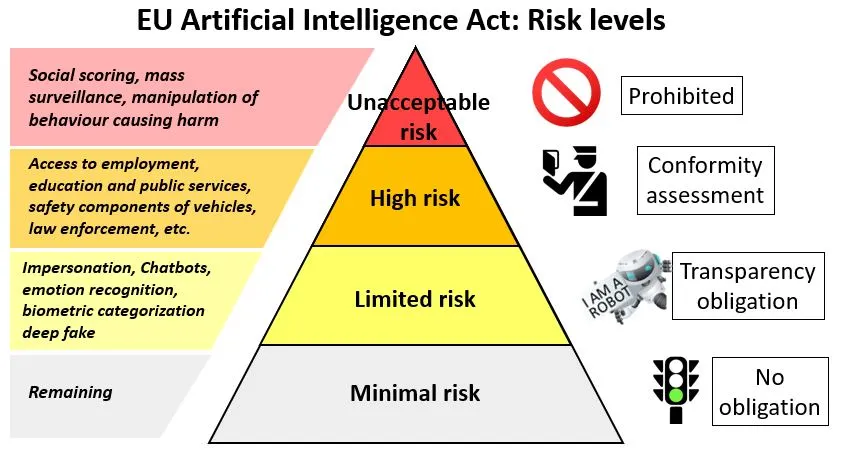

Verleden week besteedde ik in mijn zesde bloemlezing over ChatGPT aandacht aan de bijdrage Why AI-based tools are never neutral van mijn oud-collega Marco Kalz. Marco besteedt daarin aandacht aan de verschillende niveaus van risico die AI volgens de Europese Commissie heeft.

Hij schrijft dat de Europese Commissie het gebruik van AI in het onderwijs beschouwt als zeer risicovol. De Europese Commissie beschouwt AI in het onderwijs overigens als zeer risicovol als AI wordt gebruikt om gebruikers toegang te geven tot onderwijseenheden of onderdelen daarvan (bijvoorbeeld een opdracht). Tegelijkertijd valt op dat chatbots een beperkt risico hebben. En ChatGPT is een voorbeeld van een chatbot.

Je zou AI-toepassingen met een groot risico moeten onderwerpen aan een zogenaamde ‘conformity assessment‘. Daarbij beoordeel je of een applicatie zoals ChatGPT voldoet aan bepaalde eisen, normen of voorschriften. Kun je er op vertrouwen dat deze toepassing geschikt is voor het beoogde doel en voldoet aan de eisen van relevante belanghebbenden?

Je kunt het risico van ChatGPT m.i. niet los zien van de context waarin deze toepassing wordt gebruikt. Esther Verstappen stelt bijvoorbeeld dat toepassingen zoals ChatGPT een gevaar kunnen vormen voor ons intellect. Deze toepassingen genereren immers teksten zonder te beoordelen of deze teksten inhoudelijk correct zijn. Je moet volgens Esther dus als gebruiker op hoofdlijnen weten hoe deze technologieën werken, je moet herkennen als een systeem AI gebruikt, en je moet de mogelijkheden en beperkingen (bijvoorbeeld bias in gebruikte data) kennen. Anne-Marie Scott is bang dat we met dit type toepassingen de creativiteit en waardigheid van menselijke arbeid verder uithollen.

Toepassingen als ChatGPT kunnen inderdaad een groot risico vormen als de gebruiker niet in staat is de kwaliteit van de gegenereerde tekst te beoordelen, en onvoldoende ‘geletterd’ is om dergelijke toepassingen te hanteren.

Futurism besteedt aandacht aan een alternatief voor ChatGPT, genaamd ‘Claude’, waarmee gebruikers in staat zijn om te slagen voor een examen Rechten. Dit is dus ook zeer risicovol. Je loopt kans dat lerenden slagen voor een examen, zonder dat ze over de bijbehorende expertise beschikken. Je kunt dergelijke vormen van fraude volgens Erik Ofgang echter ook voorkomen door je bij toetsen en examens meer te focussen op het beoordelen van complexe denkvaardigheden, door onder meer authentieke ervaringen van lerenden te gebruiken bij opdrachten of door tools in te zetten die kunnen detecteren of een tekst is geschreven met behulp van generatieve AI-toepassingen. Je kunt dit grote risico dus ook beperken. Zie ook de prima bijdrage: De invloed van ChatGPT op toetsing: kun je nog take-home tentamens en essays gebruiken?

Andere toepassingen van dit type applicaties zijn veel minder risicovol. Bijvoorbeeld als je betrekkelijk eenvoudige feiten vragen stelt, als je ChatGPT vraagt een gedicht in een bepaalde stijl te schrijven of als je ChatGPT gewoon voor de lol gebruikt. De bijdrage 12 Cool Things You Can Do with ChatGPT bevat verschillende voorbeelden. Je kunt bovendien ChatGPT gebruiken om als docent feedback te generen, toetsvragen te construeren en activerende opdrachten te ontwikkelen (bijvoorbeeld: vergelijk deze voor- en nadelen van blended learning volgens ChatGPT met de genoemde voor- en nadelen in artikel X, Y en Z). Als docent beschik je dan over kennis en vaardigheden om de output te bewerken en verstandig te gebruiken.

Het is van belang dat je inschat hoe groot het risico van de toepassing van applicaties zoals ChatGPT is. Zonder context kun je daar m.i. geen zinvol antwoord op geven.

Mijn eerdere bijdragen over ChatGPT

- Zesde bloemlezing over ChatGPT

- Gaat ChatGPT zorgen voor een transformatie van het MBO?

- Vijfde bloemlezing over ChatGPT

- Vierde bloemlezing over ChatGPT (dit keer een korte)

- ChatGPT maakt een aantal tips op het gebied van informatievaardigheden irrelevant

- Derde bloemlezing over ChatGPT

- Nog meer weten over ChatGPT

- Meer weten over ChatGPT?

- AI content generatie tools zoals ChatGPT leiden tot kansen en uitdagingen voor leren, opleiden en onderwijs

- Twee indrukwekkende toepassingen van AI die relevant zijn voor leren, opleiden en onderwijs

- Kan AI een paper schrijven waarvoor je een voldoende krijgt? (deze is van 3 maart 2021)

This content is published under the Attribution 3.0 Unported license.

Geef een reactie